As novas versões dos sistemas operativos da Apple, onde se incluiu o iOS 15, trarão consigo um sistema com três novos recursos de proteção de crianças que visa, essencialmente, proteger a imagem dos mais novos, para que estes não caiam na teia de redes de pornografia infantil e nem em situações de assédio.

No entanto, estas novas ações têm vindo a ser muito contestadas e agora é evidente que a Apple falhou na mensagem ao anunciar as novidades.

O novo sistema da Apple para verificação de conteúdo de pornografia infantil

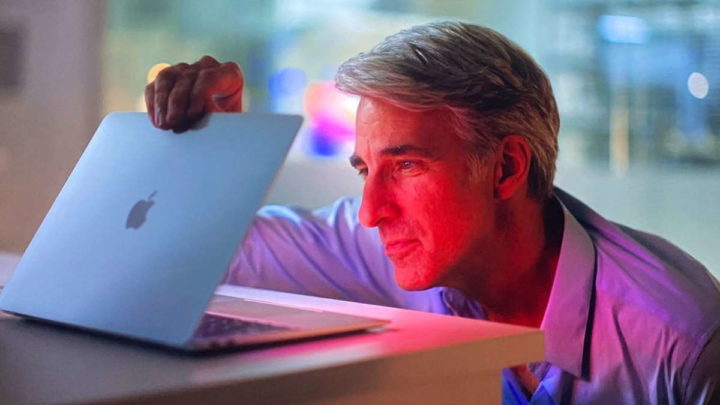

Craig Federighi, vice-presidente sénior de engenharia de software da Apple, disse que a empresa errou ao lançar os três novos recursos de proteção infantil em simultâneo e gostaria que a confusão tivesse sido evitada.

Recorde-se que no final da semana passada, a Apple anunciou três medidas destinadas a proteger as crianças até aos 13 anos de idade. Em concreto, um sistema triplo de mais informações através da Siri, uma monitorização do conteúdo do iCloud Fotografias para detetar pornografia infantil e um sistema de prevenção contra imagens explícitas na app Mensagens (iMessage).

Estas medidas chegarão com iOS 15, iPadOS 15 e macOS 12 Monterey e vão ampliar as proteções para crianças sempre com total respeito pela privacidade de todos os dados. Esta informação por si só, levanta desde logo questões relacionadas com a proteção das crianças e invasão de privacidade por parte do próprio ecossistema Apple.

Numa entrevista recente ao The Wall Street Journal, Federighi, exalta a importância das novas medidas, no entanto, não terá sido clara ao terem sido anunciadas as três novidades. Principalmente com a monitorização do conteúdo do iCloud Fotografias e na app Mensagens.

Admito que, em retrospetiva, apresentar esses dois recursos ao mesmo tempo foi uma receita para esse tipo de confusão. É muito claro que muitas mensagens foram confundidas. Eu acredito que a frase de efeito difundida foi, 'oh meu Deus, a Apple está à procura de imagens no meu telemóvel.' Não é isso que vai acontecer.

Tal como se pode ler no artigo partilhado acima, além dos novos recursos só serem ativados para crianças com menos de 13 anos e sob a indicação dos pais ou educadores, todo o sistema de análise das imagens é baseado num sistema de aprendizagem automática integrado no próprio dispositivo, mesmo no caso da deteção de imagens de menores no iCloud.

Segundo Craig Federighi, estes novos recursos surgiram mesmo no sentido de tomar uma atitude quanto ao problema do abuso de menores, mas sem interferir na privacidade dos utilizadores.

Queríamos fazer algo, mas não queríamos implantar uma solução que envolvesse a passagem por todos os dados do cliente.

Também considera que a empresa falhou na sua comunicação?

Fonte:Pplware.